LoRA: más que solo tecnología

Los LoRA (Low-Rank Adaptation) han transformado la forma en que las personas usan la inteligencia artificial. Permiten ajustar modelos existentes con mucha menos cantidad de datos y potencia de cómputo. Para artistas, diseñadores y entusiastas de la IA, esto significa capturar un estilo, tema o sujeto en un modelo compacto.

Pero detrás de esta magia tecnológica surgen preguntas difíciles. ¿Quién posee los derechos de un LoRA? ¿Es legal entrenarlo con obras de arte o fotografías ya existentes? ¿Y hasta qué punto es justo para los creadores originales de esos datos?

Copyright: zonas grises y riesgos legales

El mayor debate en torno a los LoRA gira en torno al copyright. Muchos LoRA se entrenan con conjuntos de datos que recopilan imágenes de internet, donde a menudo aparecen fotos, ilustraciones o estilos de artistas que nunca dieron su consentimiento.

- Propiedad incierta: ¿quién posee los derechos de salida de un LoRA entrenado con material protegido por derechos de autor?

- Riesgos para empresas: las compañías que usan IA en sus flujos de trabajo corren el riesgo de infringir el copyright sin saberlo.

- Artistas en protesta: cada vez más creadores denuncian que su trabajo es utilizado sin permiso en datos de entrenamiento.

La legislación está muy rezagada. Lo que hoy parece un “área gris” mañana puede convertirse en demandas o regulaciones más estrictas.

El lado ético: creatividad vs. explotación

Más allá del copyright, también existe un debate ético. Los LoRA ofrecen un gran poder creativo, pero pueden llevar a abusos:

- Robo de estilo: con unos clics se puede replicar el estilo de un artista famoso. ¿Es inspiración o plagio?

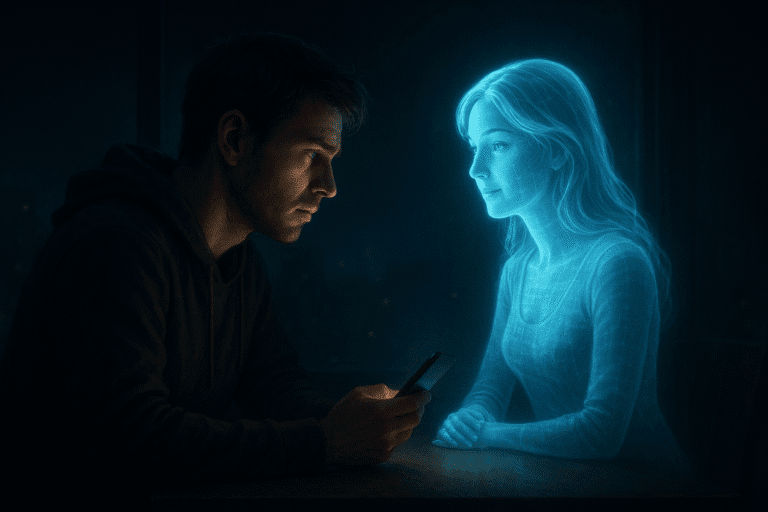

- Deepfakes y mal uso: los LoRA pueden generar imágenes falsas muy realistas de personas, con graves consecuencias para su privacidad y reputación.

- Desigualdad de recursos: las grandes empresas pueden entrenar LoRA más rápido, mejor y más barato, mientras que los creadores independientes se quedan atrás.

El equilibrio entre innovación y responsabilidad

Los LoRA son herramientas poderosas, pero nos obligan a reflexionar sobre la responsabilidad. La innovación sin ética puede derivar en abusos, desconfianza y problemas legales.

¿Qué puede hacer el usuario?

- Verificar siempre la procedencia de los datos.

- Usar los LoRA principalmente en proyectos originales y propios.

- Ser transparente sobre el uso de IA en trabajos profesionales.

Conclusión: los LoRA no son neutrales

Los LoRA son brillantes para aplicaciones creativas y prácticas, pero no son neutrales. Llevan consigo la carga de los datos de entrenamiento, incluidos los dilemas legales y éticos.

El futuro de los LoRA no estará definido solo por la tecnología, sino también por cómo creadores, usuarios y legisladores enfrentan estas zonas grises.

La gran pregunta es: ¿queremos que los LoRA sean solo más inteligentes o también más justos?